Pourquoi la plupart des projets Six Sigma meurent sur les statistiques

On va parler franchement. La plupart des projets Six Sigma que j’ai vus tourner en ETI industrielle ne meurent pas parce que la méthode est mauvaise. Ils meurent parce que les statistiques ont été survolées en formation Green Belt, récitées sur un slide en comité de pilotage, puis rangées dans un classeur où plus personne ne les ouvrira.

Le chef de projet a appris à lire un histogramme, il sait placer Cp et Cpk dans une phrase, et il s’arrête là. Pendant ce temps le processus dérive, la carte de contrôle affiche une alarme que personne ne sait interpréter, et l’ingénieur qualité relance son plan d’expérience en changeant un facteur à la fois parce que le DOE factoriel lui a toujours semblé obscur.

Le problème n’est pas la difficulté des outils. Un Cpk, une ANOVA, un plan 2^3, ce sont des objets mathématiques accessibles à tout ingénieur de production. Le problème c’est qu’on les enseigne comme des recettes, alors que ce sont des questions.

Chaque statistique répond à une question précise sur un processus, et si on ne sait pas la question, le chiffre ne vaut rien. Un Cpk de 1.67 n’est ni bon ni mauvais dans l’absolu. Il est bon si on sait ce qu’il mesure réellement, et pourquoi on le regarde lui plutôt qu’autre chose.

Cet article recense les statistiques qui, dans mon expérience de terrain, font la différence entre un projet Six Sigma qui livre du ROI et un projet qui génère du bruit dans les tableaux de bord. Ce ne sont pas les plus sophistiquées. Ce sont celles qui collent au réel et qu’on peut maintenir en routine par les équipes client, sans consultant en permanence à côté.

DMAIC en une phrase utile

Define, Measure, Analyze, Improve, Control. Le cycle DMAIC n’est rien d’autre qu’une boucle de retour d’expérience rendue explicite. On définit un problème mesurable, on mesure l’état actuel, on analyse les causes, on améliore le processus, on met sous contrôle le résultat.

La valeur du DMAIC n’est pas dans l’acronyme — elle est dans la discipline de ne jamais sauter une étape. Sauter Measure parce que “on sait déjà d’où ça vient” est la cause racine de 70 % des échecs que j’ai vus. Sauter Control parce que “c’est réglé” est la cause des 30 % restants, parce que le gain disparaît en six mois.

Measure — Capabilité Cp et Cpk, ce qu’ils disent et ne disent pas

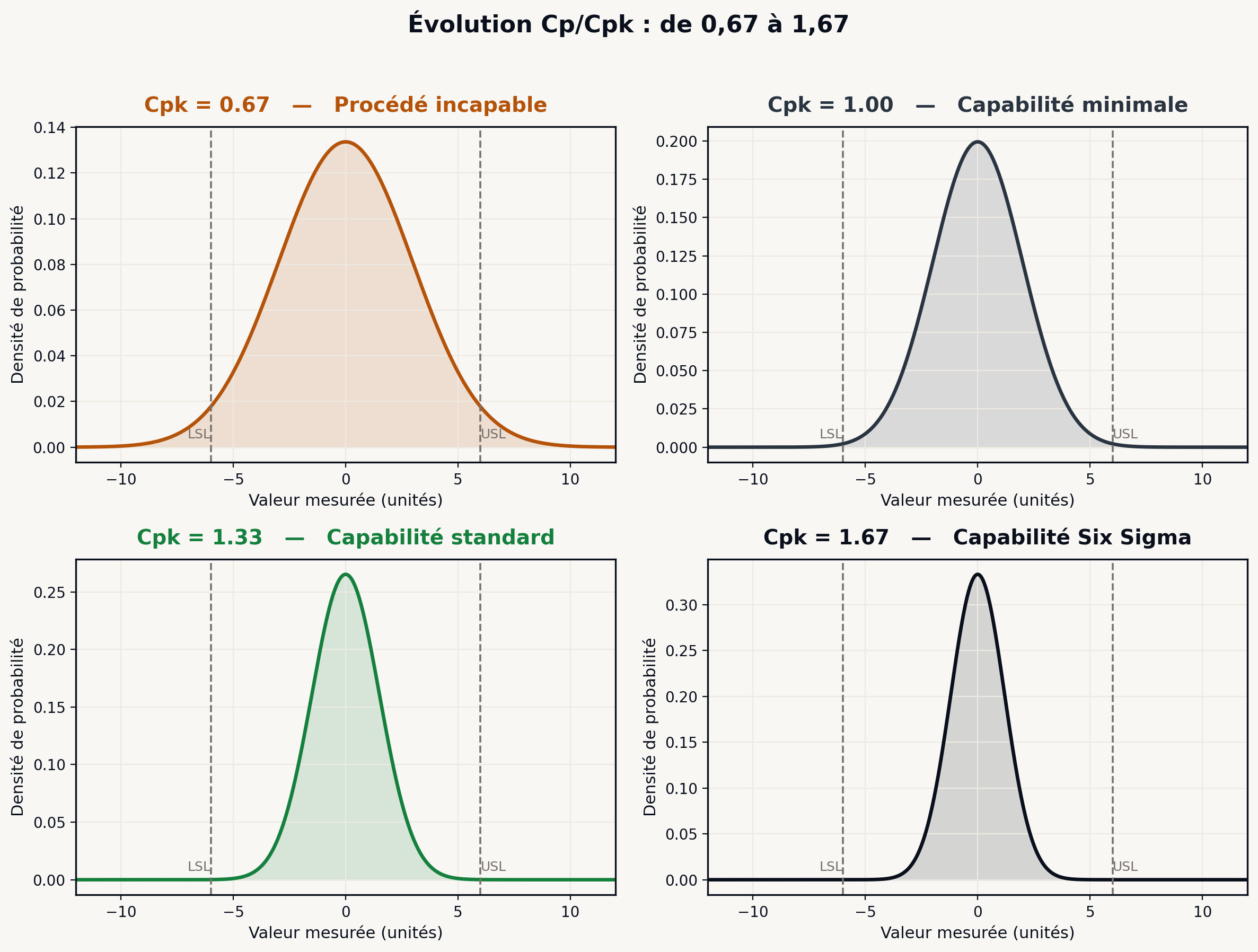

La capabilité d’un processus est la mesure de son aptitude à rester dans les tolérances du client. Deux indicateurs dominent : Cp et Cpk. Ils semblent interchangeables, ils ne le sont pas.

Cp mesure le rapport entre la largeur de tolérance et la dispersion naturelle du processus :

Cp = (USL − LSL) / 6σ

où USL et LSL sont les limites de spécification supérieure et inférieure, et σ l’écart-type du processus. Cp ne tient pas compte du centrage. Un processus peut avoir un Cp de 2.0 et produire 100 % de défauts si sa moyenne est décalée d’un côté.

Cpk corrige ça en prenant le minimum des deux demi-largeurs :

Cpk = min[(USL − μ) / 3σ, (μ − LSL) / 3σ]

où μ est la moyenne du processus. Cpk mesure donc la capabilité réelle, celle qui tient compte à la fois de la dispersion et du décalage.

Interprétation courante, bonne à avoir en tête :

- Cpk = 1.0 — le processus touche les limites, environ 2700 ppm de défauts. Inacceptable en 2026.

- Cpk = 1.33 — seuil minimum historique pour un processus “capable”. Environ 63 ppm. Beaucoup d’industriels s’arrêtent là, c’est une erreur.

- Cpk = 1.67 — niveau attendu dans l’automobile et l’aéronautique. Environ 0.6 ppm.

- Cpk = 2.0 — niveau Six Sigma vrai. Processus hors d’atteinte pour la majorité des défauts sauf causes spéciales.

Prenons un exemple chiffré. Une cote d’usinage sur une pièce mécanique : valeur cible 20.00 mm, tolérance +/-0.10 mm, donc USL = 20.10 et LSL = 19.90. On mesure 50 pièces, on obtient une moyenne de 20.02 et un écart-type de 0.025. On calcule :

Cp = (20.10 - 19.90) / (6 x 0.025) = 0.20 / 0.15 = 1.33 Cpk = min[(20.10 - 20.02) / (3 x 0.025), (20.02 - 19.90) / (3 x 0.025)] = min[1.067, 1.60] = 1.067

Le Cp dit “le processus serait capable s’il était centré”. Le Cpk dit “il ne l’est pas”. Le décalage de 0.02 mm suffit à dégrader la capabilité réelle.

La première action n’est pas de réduire la dispersion, c’est de recentrer. Beaucoup de projets Six Sigma échouent parce qu’ils attaquent la dispersion avant le centrage, ce qui revient à resserrer un boulon décalé.

Deux pièges à connaître.

Premier piège : confondre capabilité court terme et capabilité long terme. Sur 50 pièces prélevées en deux heures, on mesure un Cpk court terme. Sur un mois de production, le Cpk long terme est presque toujours plus faible — c’est attendu, la dispersion inclut les dérives entre équipes, les variations de matière, les interventions de maintenance. On note parfois Pp/Ppk pour la version long terme, c’est une convention utile à imposer dans les reportings.

Deuxième piège : ignorer la normalité. Les formules Cp/Cpk supposent une distribution normale. Si la loi est asymétrique — c’est fréquent pour des cotes de forme ou des rugosités — les seuils classiques ne tiennent plus, il faut passer par des méthodes percentile ou transformer la variable.

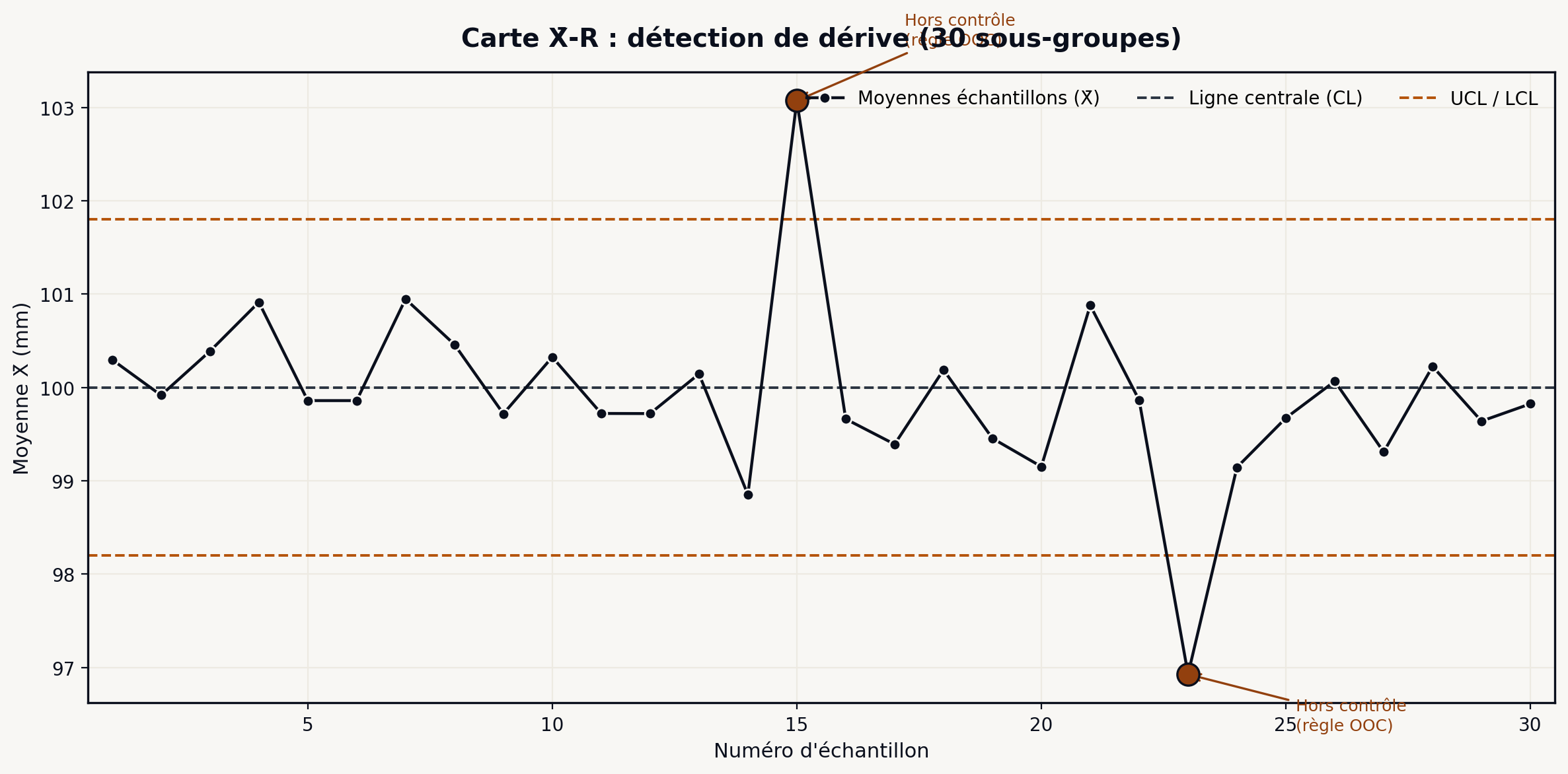

Measure — SPC, carte de contrôle et règles Western Electric

La capabilité donne une photo. Le contrôle statistique du procédé (SPC, Statistical Process Control) donne le film. Une carte de contrôle trace la moyenne et l’étendue de sous-groupes de production dans le temps, avec une ligne centrale et des limites à +/-3 sigma.

Les deux cartes les plus utilisées en production sont la carte X-bar R (moyenne et étendue de sous-groupes de 4 à 6 pièces) et la carte I-MR (individu et étendue mobile, quand les sous-groupes ne sont pas possibles, typiquement pour les processus chimiques ou continus).

Une limite de contrôle n’est pas une limite de tolérance. C’est une frontière statistique qui dit “au-delà, il y a une raison”. L’erreur classique, commise dans la moitié des ateliers visités, est de confondre les deux et de tracer les limites de spécification sur la carte de contrôle. C’est faux, ça brouille la lecture, et ça rend la carte inutile.

Les règles Western Electric sont un ensemble de patterns qui signalent qu’un processus est sorti de contrôle, même sans dépasser ±3σ. Les quatre principales :

- Un point au-delà de ±3σ (alarme classique).

- Deux points sur trois consécutifs au-delà de ±2σ du même côté.

- Quatre points sur cinq consécutifs au-delà de ±1σ du même côté.

- Huit points consécutifs du même côté de la moyenne.

Ces règles ajoutent de la sensibilité à la carte. Elles détectent des dérives lentes qu’une simple règle +/-3 sigma manquerait pendant des heures.

Elles génèrent aussi des fausses alarmes : en combinant les quatre règles, le taux de fausse alarme monte à environ 1 % par sous-groupe. C’est acceptable si la réponse à l’alarme est structurée (observation, non arrêt systématique). C’est insupportable si chaque alarme déclenche un arrêt machine — l’opérateur désactive la carte après trois jours.

La règle n1 de la mise en place SPC : calibrer le protocole d’alarme avant la carte. Qui regarde, quand, quelle action.

Analyze — ANOVA à un facteur

L’ANOVA (Analysis of Variance) répond à une question précise : est-ce que ce facteur a un effet réel sur la variable de sortie, ou ce que je vois n’est que du bruit ? Le test compare la variance expliquée par le facteur à la variance résiduelle. L’hypothèse nulle H0 est “toutes les moyennes de groupes sont égales”. Si la statistique F est grande et la p-value petite (classiquement < 0.05), on rejette H0 : le facteur a un effet significatif.

Un tableau ANOVA classique contient quatre colonnes utiles : Source (facteur, résidu, total), DDL (degrés de liberté), SS (somme des carrés), MS (moyenne des carrés, SS/DDL), F (ratio MS facteur / MS résidu), p-value.

On lit de droite à gauche. Une p-value à 0.001 dit “l’effet est statistiquement significatif”. Elle ne dit pas “l’effet est grand” — il faut regarder la magnitude du MS facteur et la différence entre moyennes de groupes pour juger l’effet pratique. Une différence statistiquement significative sur un échantillon de 10 000 pièces peut être économiquement dérisoire.

Quand utiliser l’ANOVA ? Quand on compare trois groupes ou plus sur une variable continue. Pour deux groupes on prend un test de Student (qui est un cas particulier de l’ANOVA). Pour comparer plusieurs facteurs simultanément on passe à l’ANOVA factorielle, ou directement à un plan d’expérience.

Le piège à connaître : l’ANOVA repose sur trois hypothèses — normalité des résidus, homoscédasticité (variances égales entre groupes), indépendance des observations. Si les résidus sont fortement non normaux ou si les variances sont très différentes, la p-value n’est plus fiable. En pratique, on teste les résidus avant de publier les conclusions. Un test de Shapiro-Wilk sur les résidus et un test de Levene sur les variances prennent trente secondes et évitent des conclusions fausses.

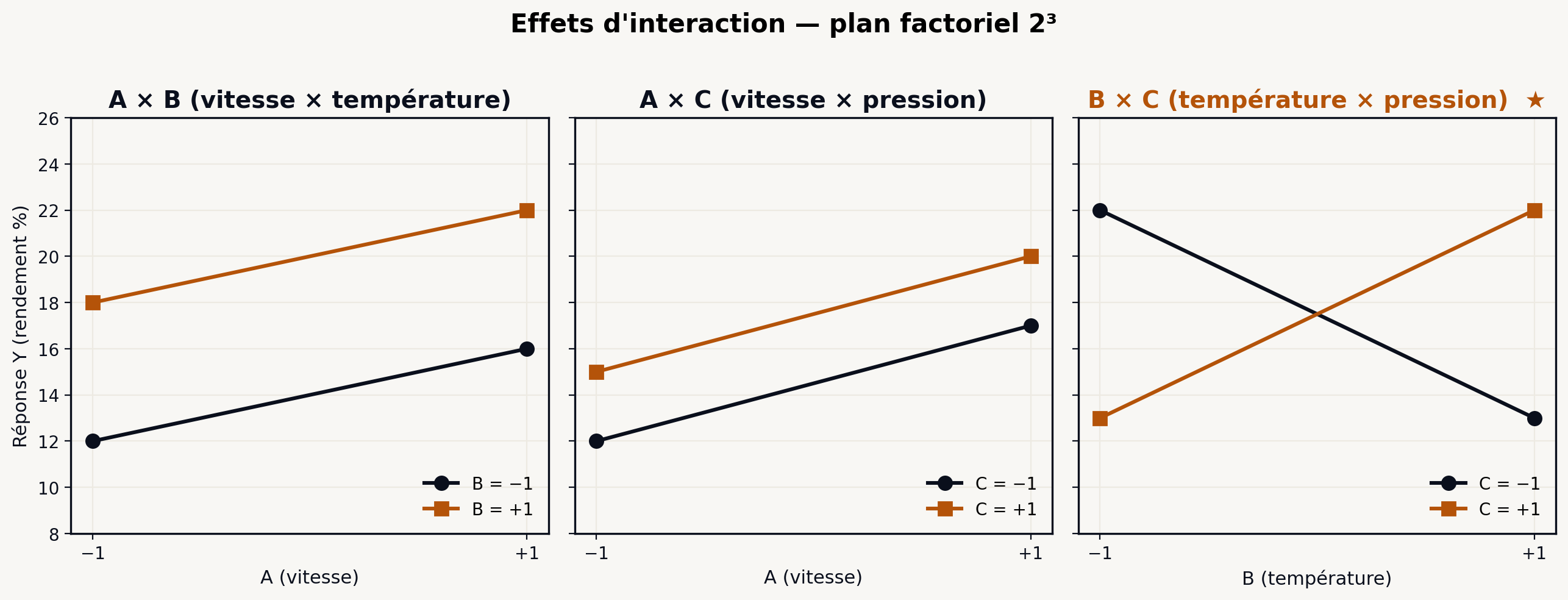

Improve — Plans d’expérience factoriels

Beaucoup d’ingénieurs font encore des essais OFAT : One Factor At a Time. On change un paramètre, on mesure, on change le suivant. C’est intuitif et c’est mauvais. L’OFAT ne détecte jamais les interactions entre facteurs, alors que ce sont précisément les interactions qui expliquent la moitié des comportements industriels intéressants.

Un plan factoriel complet teste toutes les combinaisons de niveaux de plusieurs facteurs simultanément, et permet d’estimer les effets principaux et les interactions.

La notation 2^k désigne un plan factoriel à k facteurs, chacun à 2 niveaux (bas et haut). Pour k = 3, on a 2^3 = 8 essais. Chaque facteur est codé -1 (bas) et +1 (haut), et on remplit une matrice d’expérience.

Exemple concret : réglage d’une machine d’usinage, trois facteurs — vitesse de rotation, température du lubrifiant, pression d’outil. Niveaux bas et haut définis par expertise métier. On lance les 8 essais en ordre randomisé (important pour casser les corrélations temporelles), on mesure la rugosité Ra en sortie, et l’analyse factorielle nous donne les effets principaux de chaque facteur plus les trois interactions à deux facteurs et l’interaction triple.

Si k grandit, le nombre d’essais explose : 2^5 = 32 essais, 2^7 = 128. Devient vite impraticable en production. On passe alors à un plan factoriel fractionnaire 2^(k-p), où on sacrifie l’estimation de certaines interactions d’ordre élevé pour réduire le nombre d’essais. Le concept clé est la résolution du plan : un plan de résolution III confond les effets principaux avec les interactions à 2 facteurs (dangereux), un plan de résolution IV confond les interactions à 2 facteurs entre elles (acceptable si on suppose que les interactions triples sont négligeables), un plan de résolution V sépare tous les effets principaux et interactions à 2 facteurs (idéal si le budget le permet).

Le choix résolution vs nombre d’essais est le vrai arbitrage du DOE. Il se pilote par la connaissance métier : quels facteurs sont les plus suspects, quelles interactions sont physiquement plausibles. Un DOE lancé sans cette réflexion préalable est un plan statistique, pas un plan d’expérience au sens industriel.

Le piège n°1 — Corrélation n’est pas capabilité

Voici l’erreur que je vois le plus souvent chez les clients qui ont déjà fait un cycle Six Sigma : ils affichent un Cpk de 2.0 en salle de pilotage, et ils considèrent le sujet clos.

Un processus avec Cpk = 2.0 peut dériver lentement vers le haut pendant trois mois avant que le Cpk calculé sur la nouvelle période ne descende visiblement. Si la carte de contrôle n’est pas tenue, la dérive n’est détectée que quand elle croise les limites de spécification, et à ce moment-là c’est déjà un incident client.

La capabilité est une photo. La carte de contrôle est le film. Les deux sont nécessaires. Un projet Six Sigma qui livre un Cpk sans un protocole de SPC maintenu livre un indicateur mort.

Ce qu’on n’apprend pas en formation Green Belt — Gauge R&R

On enseigne Cp, Cpk, ANOVA, DOE. On passe vingt minutes sur le MSA (Measurement System Analysis) en fin de module et on oublie. Résultat : quand je reprends un projet Six Sigma qui n’a pas donné les gains attendus, dans 40 % des cas l’origine est dans le système de mesure lui-même.

Le Gauge R&R (Repeatability and Reproducibility) mesure la part de variance introduite par l’instrument et par l’opérateur, comparée à la variance du processus. On fait mesurer plusieurs pièces par plusieurs opérateurs avec plusieurs répétitions, et on décompose la variance totale :

- Variance due aux pièces (ce qu’on veut capter)

- Variance due aux opérateurs

- Variance due à la répétition

- Variance due aux interactions

Le critère classique est le ratio %GR&R = sigma_mesure / sigma_total.

- < 10 % : système de mesure acceptable.

- 10-30 % : utilisable mais à améliorer.

- > 30 % : inutilisable, toute statistique calculée avec cette mesure est suspecte.

Si votre système de mesure a un %GR&R de 40 % et que vous calculez un Cpk de 1.5, vous ne mesurez pas votre processus, vous mesurez votre instrument. Aucune amélioration process ne fera bouger ce chiffre tant que vous n’aurez pas redressé le MSA. C’est la leçon la plus chère à apprendre en Six Sigma, et elle n’est presque jamais abordée avec la profondeur qu’elle mérite.

Ce que BCUB3 fait différemment

Les livrables classiques d’un cabinet Six Sigma : un rapport PowerPoint de 80 slides, un fichier Minitab, une recommandation. Trois mois après, plus personne ne rouvre le fichier. Six mois après, le processus est reparti à la dérive parce que personne n’a pris en charge la maintenance des outils statistiques.

Notre approche est l’inverse. On ne livre pas un rapport, on livre un pipeline : carte de contrôle connectée à la donnée temps réel de l’atelier, calcul Cpk automatique, alertes configurables sur les règles Western Electric, dashboard consulté chaque jour par la production.

Les équipes client sont formées non pas à lire les statistiques, mais à les maintenir — ajout d’un nouveau paramètre, révision des limites après changement matière, relance d’un DOE quand une dérive systémique apparaît. L’objectif n’est pas que nous restions à vie, c’est que le client devienne autonome en 6 à 12 mois, et que les acquis survivent à notre départ.

Les 7 statistiques qui comptent — rappel synthétique

Si on devait réduire Six Sigma à sept chiffres à suivre, ce seraient ceux-ci :

- Cp — capabilité potentielle, dispersion seule.

- Cpk — capabilité réelle, dispersion plus centrage.

- Pp — capabilité potentielle long terme (inclut dérives inter-équipes).

- Ppk — capabilité réelle long terme. Le vrai chiffre à suivre pour tenir des promesses clients.

- %GR&R — fiabilité du système de mesure. Sans ce chiffre, les autres sont suspects.

- p-value ANOVA — significativité statistique d’un effet. À compléter par la taille d’effet.

- Résolution DOE — niveau de confiance dans les interactions estimées par un plan fractionnaire.

Les sept sont complémentaires, aucun ne suffit seul. Le travail d’un projet Six Sigma bien mené est de les faire travailler ensemble, et de les intégrer à la routine de production pour qu’ils survivent au projet.

Pour aller plus loin

Les statistiques de Lean Six Sigma forment le socle dur d’un projet d’amélioration continue. Elles ne remplacent ni le jugement métier, ni la discipline du cycle DMAIC, ni la compétence des équipes terrain. Ce qu’elles apportent, c’est la possibilité de trancher sur des faits plutôt que sur des impressions, et d’éviter les conclusions hâtives qui coûtent plus cher que l’absence de projet.

Pour aller plus loin sur ce que le machine learning peut ajouter à chaque étape DMAIC sans la remplacer, voir l’article Lean Six Sigma × Machine Learning : le combo qui change la donne. Et si le sujet des pipelines ML en production vous intéresse, l’article Machine Learning pour l’industrie : du signal au modèle en production détaille les pièges qu’on évite rarement sans expérience terrain.